Pour le SNES-FSU, les outils numériques ne peuvent définir une politique éducative. Et la promotion de nouvelles technologies par le monde industriel et économique ne peut pas définir une politique d’apprentissage. Quant aux impacts sur les métiers et les conditions de travail, ils doivent être eux aussi sérieusement évalués avant tout déploiement.

C’est pourquoi le SNES-FSU a proposé de nombreux amendements pour infléchir le projet du Ministère, tout en étant conscient de la portée réglementaire limitée d’un « cadre d’usage ». Les analyses présentées dans cet article portent sur la version soumise au vote du Conseil supérieur de l’éducation du 22 mai, désapprouvée par 24 voix contre (dont celles de la FSU), 12 pour et 4 abstentions. Le CSE étant une instance consultative, la version définitive du cadre d’usage après intégration de certains amendements n’est pas encore publiée à ce jour.

Une communauté éducative consultée ?

L’initiative du « cadre d’usage » revient à la DNE (Direction du numérique pour l’éducation) et les agent·es concerné·es n’y ont été associé·es que tardivement. Ainsi, les objectifs de ce texte et sa forme étaient fixés. En effet, c’est seulement en janvier 2025 que le SNES-FSU ainsi que les autres organisations syndicales, les représentant·es des parents et des élèves ont été invité·es à une réunion d’1h30 avec la DNE. Cette réunion, qui a tout juste permis de prendre connaissance d’un projet déjà très avancé, a été suivie d’une seconde (convoquée le 6 février pour le 14…) en présence cette fois de la DNE et de la DGESCO (Direction générale de l’enseignement scolaire). Le SNES-FSU a exigé lors de ces deux réunions d’échanges (qui, au vu de leur durée et du nombre des participant·es, n’ont pas vraiment permis une analyse approfondie) que le “cadre d’usage” soit examiné au Conseil supérieur de l’éducation, comme tout texte réglementaire concernant l’Éducation nationale. Il est largement abusif d’affirmer, comme le fait le Ministère dans son document de présentation, qu’une consultation « de l’ensemble de la communauté éducative a été menée entre la mi-janvier et la fin du mois de mars. » Combien de collègues ont en effet entendu parler de ce cadre d’usage ? Combien ont pu véritablement peser sur son contenu ?

L’examen du projet de texte au Conseil supérieur de l’éducation a duré 5 heures, démontrant la nécessité d’un débat sur le fond. D’autant que le travail en CSE avait lui-même été préparé par de longs échanges en Commission spécialisée, certaines modifications étant actées. A nouveau, lors du CSE du 22 mai, 8 des amendements proposés par le SNES-FSU ont été intégrés en séance, et 10 doivent l’être après réécriture.

Quels objectifs pour un « cadre d’usage de l’IA en éducation » ?

Ci-dessous le projet de cadre soumis au CSE. Cette version n’est donc pas définitive. Des évolutions, que nous espérons importantes, sont attendues lors de sa publication au BO.

Si le Ministère a jugé utile de rédiger une longue introduction, le SNES-FSU a argumenté en faveur d’un texte court. En effet, les pages introductives sont presque aussi longues que le « cadre d’usage » en lui-même, et se perdent dans des considérations générales sur l’IA en éducation. L’objectif du document semble davantage de permettre un développement des usages que de poser des limites. Le ton général est positif, affirmatif quant au développement futur, prétendument désirable et inévitable, de ces technologies, en particulier dans le paragraphe « 3.1 Des usages en pleine explosion ouvrant de nombreuses potentialités ». Les effets néfastes d’ores et déjà connus, qu’ils soient économiques, écologiques, politiques, ou cognitifs, sont minorés. C’est pourquoi le SNES-FSU a souhaité ajouter, dans l’exposé des impacts des IA dans l’éducation : « Les IA peuvent aussi mettre en danger le statut même de la vérité et charrier un grand nombre de biais favorables à toutes les formes de discrimination combattues par l’École. » Dans la même logique, alors que le Ministère affirme que les IA sont utiles pour « soutenir le « geste enseignant » (dans la préparation de cours, l’aide à l’évaluation…) et pour simplifier des tâches administratives », le SNES-FSU revendique que cela reste à la main des agent·es. Il s’agit d’une part de se prémunir de la possibilité d’imposer des outils aux personnels, et d’autre part de les sensibiliser à l’importance de garder la maîtrise de la conception de leur travail. Il est aussi crucial d’évaluer la manière dont les outils utilisés modifient le sens de nos métiers.

Les vertus prêtées à l’IA dans le projet de cadre d’usage, à savoir « faciliter la personnalisation des apprentissages, adapter les actions de remédiation aux besoins de chacun », ne sont de toutes façons pas justifiées par quelque source scientifique que ce soit. Le texte reprend en fait à son compte les discours publicitaires des entreprises de l’EdTech. Aucune recherche ne démontre la possibilité d’une véritable « personnalisation » ou adaptation des actions de « remédiation ». Pour le SNES-FSU, cette affirmation non étayée devrait être supprimée. De même, l’objectif affiché « d’appropriation de l’IA » dévoie le rôle d’un « cadre d’usage » qui est de… cadrer, donc de délimiter, de donner des règles précises bornant l’usage des IA. Si appropriation il doit y avoir, c’est bien celle de tous les enjeux qui s’y rapportent.

Un cadre juridique négligé

Pour le SNES-FSU, le premier intérêt d’un « cadre d’usage » serait de rappeler à tous les personnels de l’Éducation nationale (y compris les personnels de direction, et les cadres : DASEN, recteurs et rectrices) leurs obligations légales. Or les textes applicables ne figurent dans le projet qu’en notes infrapaginales, et le paragraphe sur la protection des données est très peu développé. Les usages (pédagogiques et administratifs) de l’IA par les personnels, les élèves et leurs représentant·es, avant de se conformer au « cadre d’usage » (dont la portée réglementaire est discutable) doivent obéir aux normes juridiques en vigueur. Celles-ci sont mal connues car le Ministère ne fait que très peu d’efforts pour y former ses personnels, et en informer les usager·es. Elles sont notamment définies par le Code de l’éducation, la loi informatique et libertés, la loi pour une République numérique, le Règlement général sur la protection des données (RGPD), la loi pour sécuriser et réguler l’espace numérique (SREN) et le Règlement européen sur l’intelligence artificielle (RIA). Ce dernier définit les systèmes d’IA « utilisés pour déterminer l’accès à l’éducation et à la formation professionnelle, pour évaluer les résultats d’apprentissage ou pour contrôler les étudiants » comme des usages à haut risque.

Aucun usage des IA grand public dans un cadre éducatif (usage dit personnel ou expérimentation, en classe comme à la maison) impliquant des données à caractère personnel n’est possible sans contrat passé par le responsable de traitement des données (DASEN par délégation du recteur pour le premier degré, chef d’établissement pour le second degré), qui en a la prérogative et la responsabilité. Hors de ce cadre, aucune demande d’autorisation d’usage aux élèves et à leurs responsables légaux n’est juridiquement fondée. Par ailleurs, il est faux d’écrire que « tout enseignant peut utiliser des IA accessibles au grand public, sous sa responsabilité » puisqu’aucun·e enseignant·e n’a la qualité de responsable de traitement des données. Cette fonction, imposée par le RGPD, incombe à sa hiérarchie.

Pouvoir exercer son métier et apprendre sans IA

Dans ses « valeurs et principes », le projet du Ministère stipule que « l’IA doit être utilisée de manière responsable et réflexive ». Mais pour que l’IA soit utilisée de manière responsable et réflexive, l’expertise professionnelle des personnels doit guider ses usages. L’IA ne peut s’y substituer ou la contraindre. Dans le cadre de la classe et des apprentissages, il est impératif de prendre toutes les précautions nécessaires, notamment au vu des résultats des recherches les plus récentes sur les impacts cognitifs, relationnels et sur la citoyenneté en construction des élèves.

Un autre enjeu est celui de l’impact écologique. Quand un « usage frugal » est recommandé, il faut rappeler que la frugalité consiste à n’utiliser les IA que si aucune autre solution moins coûteuse écologiquement ne peut répondre aux objectifs professionnels et pédagogiques. Le Ministère affirme lui-même dans son projet que l’IA est une « technologie fortement consommatrice en ressources matérielles, en eau et en énergie ». Parler d’un usage frugal relève presque de l’oxymore. Compte tenu de tous ces enjeux, chaque personnel et chaque usager·e doit avoir la liberté réelle d’exercer ses missions ou d’accéder au service public d’éducation sans en passer par l’IA.

Ainsi, le SNES-FSU lors du Conseil supérieur de l’éducation a défendu plusieurs amendements pour retirer du « cadre d’usage » les passages formulant de manière intrusive des recommandations pédagogiques. Il a également demandé à ce que les professionnel·les soient dûment informé·es des effets sur les apprentissages et le développement des processus cognitifs et relationnels des élèves, sur la base de recherches scientifiques indépendantes des autorités de tutelle comme des intérêts économiques.

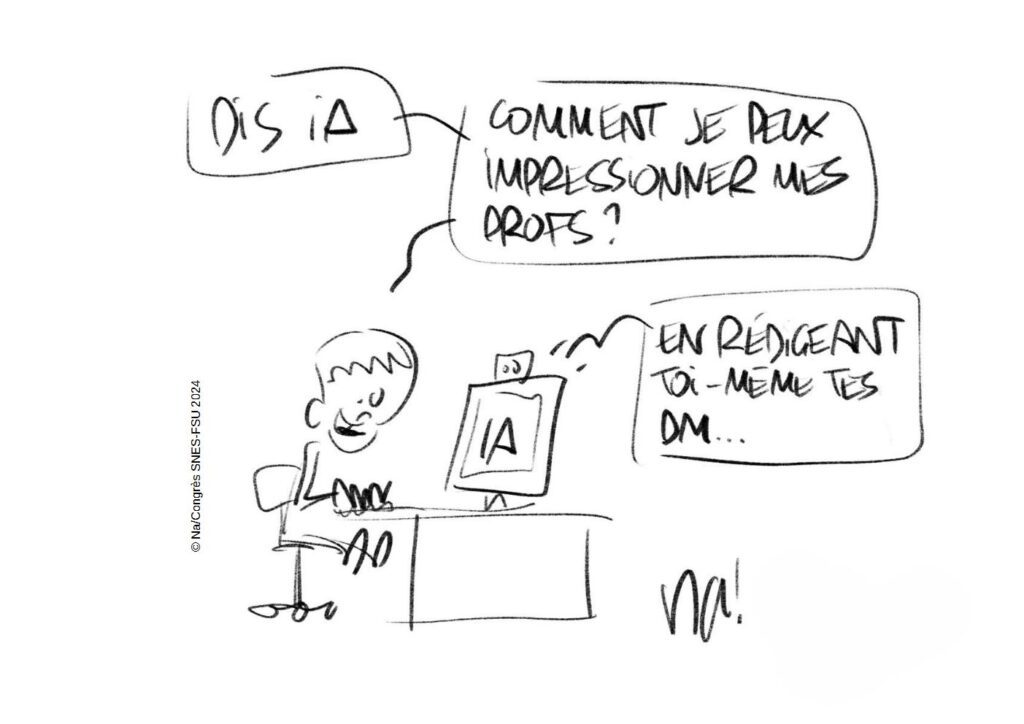

Les élèves aussi doivent être sensibilisés aux risques et limites des IA. La progression fulgurante de leurs usages problématiques nécessite de maintenir la capacité à apprendre sans recours aux IA. Le SNES-FSU a défendu l’amendement suivant : « L’usage volontaire et non déclaré des IA génératives pour réaliser un travail scolaire sans demande explicite de l’enseignant est une forme de triche. Son usage non autorisé dans le cadre d’une évaluation ou d’un devoir maison est puni ou sanctionné. » Le texte proposé par le Ministère se contentait d’affirmer qu’il fallait que les établissements « prennent en compte la réalité des usages des IA par les élèves » pour « adapter et diversifier leur politique en matière de devoirs et d’évaluation » (notamment le projet local d’évaluation au lycée). Or s’attribuer en tant qu’auteur un contenu généré par une IA est malhonnête, tout comme s’attribuer les idées, les analyses, les mots d’autrui sans citer ses sources. Déclarer que cet usage de l’IA est une forme de triche est une clarification attendue par les personnels, une clarification qui serait salutaire pour les élèves et pour leurs familles.

Enfin, le fait de maintenir une formation dans laquelle le recours aux IA ne doit être qu’exceptionnel est indispensable pour préserver et développer les capacités d’apprentissage, de sociabilité et d’épanouissement des élèves. Le SNES-FSU a donc proposé d’ajouter à la toute fin de la partie « A retenir » du cadre du d’usage : « Pour tous les niveaux, les personnels soulignent et démontrent la nécessité de maintenir la capacité à apprendre sans recours aux IA. »

Élections professionnelles :

Élections professionnelles :